Das ist mir ehrlich gesagt immer noch eine zu gewagte These, solange sie nicht durch konkrete Messungen bestätigt ist.

Wie soll das für den OP darstellbar sein, so eine Messung?

Für mich ist das keine These sondern ständig erlebte Praxis. Das kannst Du mir jetzt abnehmen oder auch nicht, so sind halt meine Erfahrungen in diesem Zusammenhang.

Für Windows 10 sind in der Reihenfolge Festplatte (gute bzw. schnelle SSD), RAM (mehr als 4 GB) und dann erst CPU (i5 sollte sein) maßgeblich, ob es rund läuft.

Erst diese Woche hatte ich wieder das 'Vergnügen' mit einem Primergy TX1330 M2 und RAID5, wo der Server während des jüngsten Windows Update mindestens 4 Stunden lang die Festplatten auf 100% am Anschlag hatte, das System in der Zeit kaum zu bedienen war. Die CPU spielte dabei kaum eine Rolle. Limitierend ist die I/O-Performance der HDs und des RAID-Controllers.

(Und ja, da hat jemand die Idee gehabt, ein Windows 10 auf eine Serverplattform zu installieren ![]() - geerbte Baustelle mit Ablösehorizont in Sicht).

- geerbte Baustelle mit Ablösehorizont in Sicht).

Oder Anfang des Jahres ein ESPRIMO 9900 (Desktop) i5-750, 4 GB aus 2010 mit 2 x 500 GB SATA als RAID1. Der bekam keine SSD mehr und der hat auch dauernd Situationen, wo die HDs als RAID1 100% Auslastung anzeigen mit entsprechenden Auswirkungen auf die Bedienbarkeit.

Oder ein Lifebook 753 mit i5-3230M aus 2013 und 4 GB vor ein paar Wochen. Mit einer SSD aufgerüstet geht es - vorher mit klassischer Festplatte unter Windows 10 unbenutzbar, aber die RAM-Aufrüstung liegt hier noch bereit, weil es da auch diese Effekte gibt.

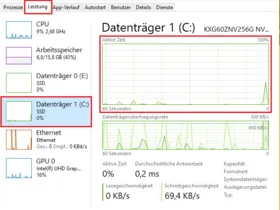

Was kklepper freilich noch tun könnte, um es zu bestätigen: Taskmanager in den einschlägigen Situationenen prüfen.

Wenn der markierte Graph auch nur vorübergehend an 100% geht, dann hat das Auswirkungen auf das Reaktionsverhalten von Anwendungen und GUI. Würde das für Dich als Messung gelten Susi to visit ?

Gruß

Sehvornix